返回新闻列表

研究

Shisa-Gamma-7b-v1 下载量突破 100 万次

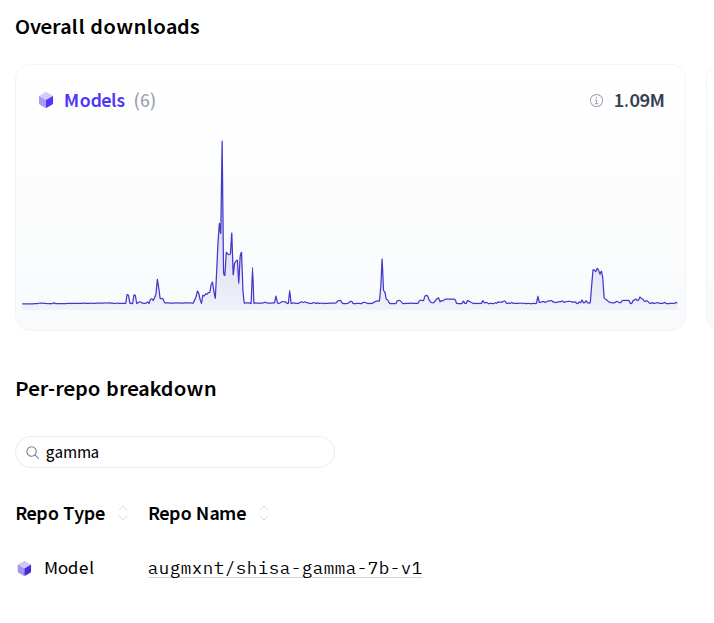

在作为演化模型合并的核心底座发布一年后,我们的模型达成这一重要里程碑。

距离 Sakana AI 发布关于 LLM 演化模型合并 的开创性研究已过去一整年,该研究采用了我们的 shisa-gamma-7b-v1 作为日语模型底座。我们非常荣幸看到该研究成果于今年 1 月发表在 《自然·机器智能》 (Nature Machine Intelligence) 上。

得益于该项研究的广泛影响,以及模型在 Weights & Biases Nejumi LLM 排行榜 上的持续优异表现,该模型获得了社区的广泛认可,目前下载量已正式突破 100 万次。

在持续创新的过程中,我们诚邀您体验最新的 shisa-v2-llama3.1-8b-preview 模型。这是我们迄今为止最强大的版本,在指令遵循、创意写作能力及分词效率方面均有显著提升。

我们衷心感谢 Mistral AI、Stability AI Japan 以及开源 AI 社区的宝贵贡献,正是由于你们的支持,才使得这一切成为可能。

News

全部文章 更多新闻

研究

Shisa 7B 发布

一款基于合成数据驱动方法的双语通用聊天模型。

阅读全文 研究

Shisa.AI 开发出具备行业领先性能的多语言大语言模型

发布了一款参数规模达 405B 的开源大语言模型,在日语任务中表现超越 GPT-4。

阅读全文